La inteligencia artificial ya no está limitada a laboratorios de investigación aislados o entornos de ciencia de datos. Para el año 2026, la IA se ha convertido en un componente operativo esencial dentro del software empresarial, impulsando la toma de decisiones, la automatización, la experiencia del cliente y el análisis en tiempo real. Sin embargo, las organizaciones están reconociendo cada vez más que las plataformas de desarrollo tradicionales no estaban diseñadas para manejar las demandas únicas de las cargas de trabajo de IA a escala de producción. Esta comprensión ha impulsado el surgimiento de plataformas nativas de desarrollo para la IA, específicamente diseñadas para manejar las complejas necesidades de infraestructura de sistemas de aprendizaje automático y generación de IA.

Desafíos operativos con plataformas heredadas

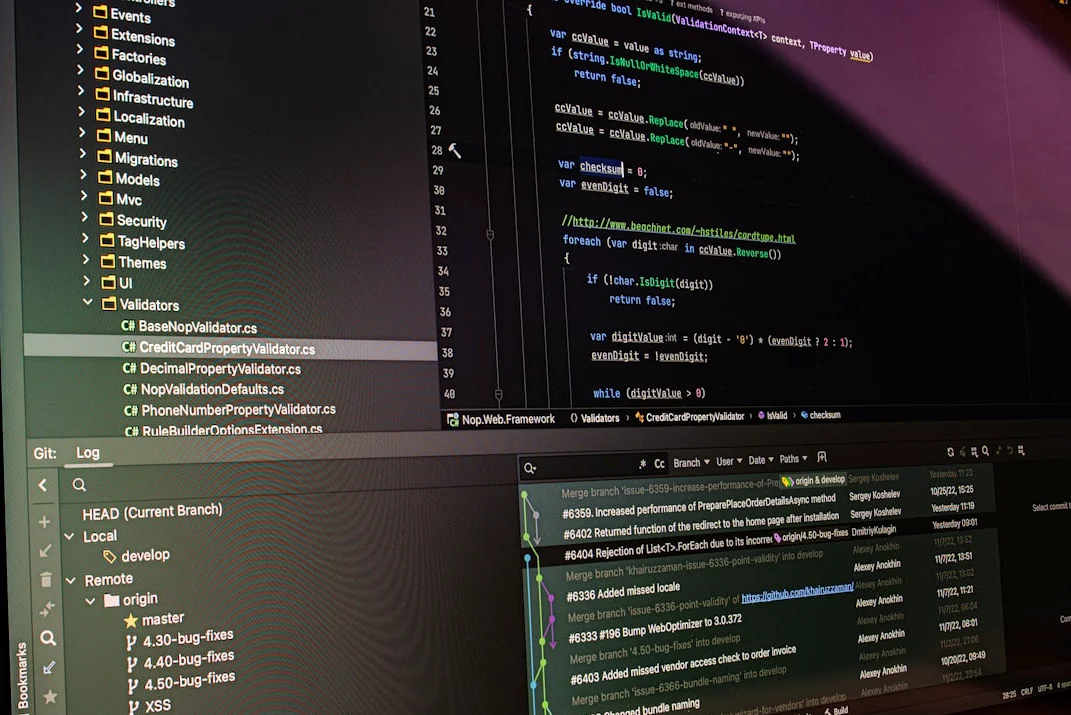

Históricamente, las aplicaciones empresariales se construyeron utilizando plataformas optimizadas para aplicaciones web, bases de datos y cargas de trabajo transaccionales. Estos entornos son adecuados para el software tradicional, pero se quedan cortos al manejar los grandes volúmenes de datos, el cómputo de alta performance y los entornos de entrenamiento distribuido que requiere la IA. Los científicos de datos y ingenieros han dependido frecuentemente de una mezcla de herramientas separadas para la preparación de datos, el entrenamiento de modelos, la implementación y el monitoreo. Este ecosistema fragmentado se vuelve cada vez más difícil de manejar a medida que los proyectos de IA crecen en escala y complejidad.

Las organizaciones enfrentan con frecuencia desafíos como silos de datos, herramientas inconsistentes y pipelines fragmentados. Cuando los equipos intentan integrar estas capacidades manualmente, el resultado es una arquitectura fragmentada que ralentiza el desarrollo y aumenta la complejidad operativa. Esto ha llevado a una creciente necesidad de plataformas nativas de desarrollo para la IA que consolidan estos componentes en un entorno único y unificado.

Las plataformas nativas de IA están específicamente diseñadas para apoyar los flujos de trabajo de aprendizaje automático, en lugar de adaptar herramientas tradicionales de desarrollo de software. Estos entornos integran los componentes esenciales necesarios para construir, entrenar, implementar y gestionar sistemas de IA. Las capacidades clave suelen incluir soporte integrado para pipelines de datos, orquestación de modelos, aceleración de GPU y despliegue automatizado. Al consolidar estas capacidades en un solo entorno, las organizaciones pueden acelerar el desarrollo de IA manteniendo el control operativo.

Ventajas estratégicas de las plataformas nativas de IA

El auge de las plataformas nativas de IA refleja un cambio más amplio en la forma en que las empresas abordan la infraestructura. En lugar de ensamblar la infraestructura pieza por pieza, las empresas están adoptando plataformas que ofrecen capacidades de IA como un sistema cohesivo. Este enfoque simplifica varios aspectos de la implementación de IA, incluyendo la complejidad operativa, la colaboración y la velocidad de desarrollo.

En primer lugar, reduce la complejidad operativa. Los equipos de ingeniería ya no necesitan manejar docenas de herramientas separadas para pipelines de datos, infraestructura de entrenamiento, registros de modelos y sistemas de despliegue. En segundo lugar, mejora la colaboración. Los científicos de datos, ingenieros de ML y desarrolladores de software pueden trabajar dentro del mismo entorno, compartiendo pipelines, modelos y conjuntos de datos. En tercer lugar, acelera los ciclos de desarrollo. Los pipelines automatizados y la infraestructura escalable permiten a las organizaciones pasar de la experimentación de modelos al despliegue en producción mucho más rápido.

Estas ventajas se vuelven cada vez más importantes a medida que la IA se profundiza en las operaciones empresariales. Por ejemplo, los modelos de lenguaje grandes, los sistemas de generación aumentada por recuperación y los agentes de IA autónomos requieren pilas de infraestructura complejas. Gestionar estos componentes por separado introduce un gran sobrecarga de ingeniería. Las plataformas nativas de IA ofrecen pipelines preintegrados que simplifican la construcción y el despliegue de estos sistemas de IA avanzados.

Actualmente, muchas plataformas incluyen soporte integrado para bases de datos vectoriales, pipelines de recuperación de conocimiento, marcos de orquestación y optimización de modelos. Estas capacidades permiten a las organizaciones construir aplicaciones de IA sofisticadas sin tener que gestionar cada componente de infraestructura individualmente. A medida que la adopción de IA se expande por departamentos, estas ventajas ayudan a las organizaciones a mantener la eficiencia operativa mientras escalan la innovación.

Futuro de la infraestructura de IA

La evolución de la infraestructura de IA aún está en sus primeras etapas. Durante los próximos años, se espera que las plataformas nativas de IA se vuelvan aún más sofisticadas. Los desarrollos futuros probablemente incluirán una integración más profunda entre plataformas de datos y sistemas de IA, optimización automatizada de modelos, capas de abstracción de hardware mejoradas y marcos de gobernanza mejorados.

A medida que las empresas continúan integrando la IA en sus operaciones, las plataformas construidas específicamente para el desarrollo de IA desempeñarán un papel central en el apoyo a esta transformación. En lugar de adaptar la infraestructura tradicional para acomodar el aprendizaje automático, las organizaciones están adoptando cada vez más plataformas donde la IA es la base del sistema completo. Para las empresas que buscan escalar la IA con éxito, el movimiento hacia entornos de desarrollo nativos de IA podría resultar en uno de los cambios más importantes en la infraestructura de la década.

Además de la evolución técnica de las plataformas nativas de IA, la importancia estratégica de asegurar la infraestructura de IA se manifiesta en los recientes desarrollos del sector. Por ejemplo, el acuerdo de infraestructura de cinco años y 27.000 millones de dólares entre Meta y Nebius subraya la creciente demanda de hardware especializado y servicios en la nube para IA. Esta alianza, anunciada el 16 de marzo de 2026, implica que Nebius suministrará a Meta capacidad de centros de datos dedicados para alimentar sus modelos de IA de próxima generación, incluyendo acceso a los próximos chips Vera Rubin de Nvidia.

El compromiso de Meta con la infraestructura de IA destaca las exigentes demandas computacionales de entrenar modelos de código abierto cada vez más sofisticados, como la serie Llama. La empresa se reporta planeando gastos de capital relacionados con IA de hasta 135.000 millones de dólares este año solo, una cifra que supera ampliamente el valor de mercado de muchas empresas del Fortune 500. Al

Comentarios

Aún no hay comentarios

Sé el primero en compartir tu opinión