Präsident Donald Trump hat alle US-Regierungsbehörden angewiesen, die Nutzung des KI-Modells Claude von Anthropic sofort einzustellen und hat das Unternehmen als ‘Risiko für die Lieferkette’ bezeichnet – eine Bezeichnung, die normalerweise für Firmen aus feindlichen Ländern reserviert ist. Dieser Schritt folgt auf die Ablehnung von Anthropics Bitte, Sicherheitsvorkehrungen für die militärische Nutzung des KI-Modells zu entfernen, wobei das Unternehmen ethische Bedenken hinsichtlich der möglichen Nutzung in Massenüberwachung und autonomen Waffen angab.

Auswirkungen auf Pentagon-Verträge und militärische Operationen

Das Pentagon wird seinen Vertrag mit Anthropic, der bis zu 200 Millionen Dollar wert ist, beenden und verlangt, dass andere Regierungsvertragspartner bestätigen, dass sie das Modell Claude in ihren Arbeitsabläufen nicht nutzen. Anthropic wird zudem von allen anderen Regierungsprojekten ausgeschlossen, wobei ein sechsmonatiger Übergangszeitraum gewährt wird, um den Wechsel zu anderen KI-Modellen zu ermöglichen.

Die Entscheidung ist besonders bemerkenswert, da Claude das einzige KI-Modell ist, das derzeit in den geheimen Systemen der Streitkräfte genutzt wird. Es wurde berichtet. Dass es bei der Operation zur Verhaftung des venezolanischen Präsidenten Nicolás Maduro genutzt wurde und in zukünftigen militärischen Operationen, beispielsweise in Iran, eingesetzt werden könnte.

Verteidigungsbeamte haben die Schwierigkeit anerkannt, Claude zu ersetzen, wobei einer den Prozess des Abkoppelns vom Modell als ‘riesigen Ärger’ beschrieb. Der Schritt kompliziert auch die Arbeit für die KI-Softwarefirma Palantir, die auf Claude für ihre sensibelsten Arbeiten mit der Streitkräfte angewiesen ist und wahrscheinlich einen Ersatz suchen muss.

Politische und ethische Spannungen

Trump’s Anordnung. Veröffentlicht auf Truth Social. Warf Anthropic vor. Versuchen zu wollen. Das Verteidigungsministerium zu ‘erzwingen’ und ihre Richtlinien an ‘woken’ Werte anzupassen, anstatt an die US-Verfassung zu halten. Er bezeichnete die Haltung des Unternehmens als ‘katastrophalen Fehler’ und versprach, dass die USA ‘nie eine radikale linke, woken Firma erlauben würden, zu bestimmen, wie unsere großartige Streitkraft Kriege kämpft und gewinnt.’

Der CEO von Anthropic. Dario Amodei, hatte zuvor die ‘beste und letzte Angebotsvorlage’ des Pentagon abgelehnt und sagte, das Unternehmen könne nicht in gutem Gewissen auf die Bitte eingehen, but In Reaktion darauf warf der stellvertretende Verteidigungsminister Emil Michael Amodei einen ‘Gott-Komplex’ vor und sagte, er setze die Sicherheit des Landes aufs Spiel.

Amodei erklärte, wenn das Pentagon beschließt, Anthropic zu entlassen, werde das Unternehmen sicherstellen, dass der Übergang zu einem anderen Anbieter reibungslos verlaufe, um Störungen militärischer Operationen zu minimieren. Die finanziellen Risiken sind jedoch hoch, da Anthropic Hunderte Millionen Dollar an potenziellen Regierungsverträgen verlieren könnte und Kunden verlieren könnte, die ihr KI-Modell aufgrund der Blockade meiden.

Weitere Auswirkungen auf die KI-Regulierung

Das Pentagon argumentiert, dass die Nutzung von KI in militärischen Anwendungen komplexe ethische und rechtliche Fragen aufwirft und es unpraktisch sei, jeden Fall mit privaten Unternehmen zu verhandeln. Es verlangt, dass alle KI-Unternehmen ihre Modelle für ‘alle rechtmäßigen Zwecke’ verfügbar machen, eine Haltung, die von Anthropic und anderen in der Branche kritisiert wird.

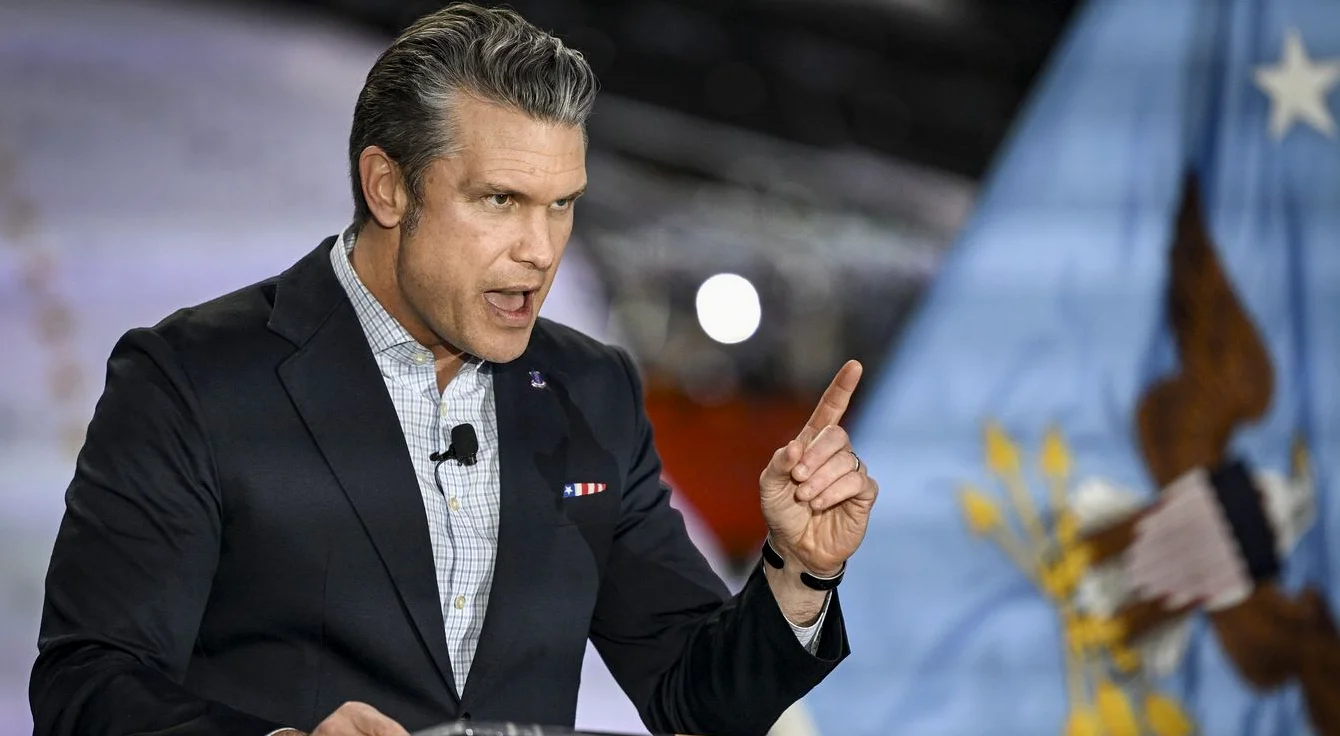

Der Verteidigungsminister Pete Hegseth kritisierte wiederholt ‘woke AI’ und die Trump-Regierung hat sich zunehmend gegen Anthropic gewandt, obwohl die Streitkräfte auf dessen Technologie angewiesen sind. Ein Verteidigungsbeamter sagte Axios, dass die USA Anthropic weiterhin aus Notwendigkeit nutzen, wobei die Fähigkeiten des Unternehmens anerkannt werden.

Elon Musks xAI hat kürzlich einen Vertrag unterzeichnet, der es dem Militär erlaubt, sein KI-Modell Grok in geheimen Systemen zu nutzen. Quellen deuten jedoch darauf hin, dass Grok nicht als direkter Ersatz für Claude dienen wird. Inzwischen sind Googles Gemini und OpenAIs ChatGPT in unklassifizierten Systemen verfügbar, und das Pentagon beschleunigt Gespräche, um sie in klassifizierte Umgebungen zu integrieren.

In Reaktion auf die Situation haben hunderte Mitarbeiter von Google und OpenAI eine Petition unterzeichnet, in der sie ihre Unternehmen auffordern, sich mit der Haltung von Anthropic zu ethischer KI-Nutzung zu alignieren. OpenAI-CEO Sam Altman bestätigte, dass das Unternehmen ähnliche Grenzen für Überwachung und autonome Waffen beibehalten wird, bleibt aber bereit, mit dem Pentagon zu verhandeln.

Anthropic hat noch nicht angekündigt, ob es die Bezeichnung der Regierung vor Gericht anfechten wird. Das Unternehmen, das sich schnell entwickelt und in Schlüsselunternehmen Anwendung findet, steht nun einem möglichen Wendepunkt gegenüber, der seine ethische Position und sein finanzielles Zukunftsszenario beeinflussen könnte.

Kommentare

Noch keine Kommentare

Be the first to share your thoughts