Con el auge de los modelos fundamentales (FMs) en imágenes médicas, expertos expresan optimismo cauteloso sobre su potencial para transformar el diagnóstico, pidiendo al mismo tiempo protecciones estrictas de la privacidad y marcos regulatorios. Un estudio reciente publicado en npj Digital Medicine destaca el desafío dual de aprovechar estos poderosos sistemas de inteligencia artificial para beneficio clínico sin comprometer la privacidad de los pacientes. La investigación subraya la necesidad de intervenciones técnicas, de gobernanza y regulatorias para garantizar que los FMs entreguen innovación sin exponer a individuos a riesgos de reidentificación.

Soluciones técnicas y desafíos de privacidad

El estudio identifica desafíos técnicos clave en la implementación de modelos fundamentales en imágenes médicas, especialmente el riesgo de reidentificación cuando las salidas del modelo se combinan con conjuntos de datos externos. Los investigadores señalan que los estudios actuales suelen utilizar cohortes con diversidad limitada, lo que puede no reflejar el espectro completo de riesgos de privacidad en escenarios reales. Por ejemplo, un estudio de ablación de características o mapeo de atención podría aclarar si la capacidad predictiva del modelo para demografía es verdaderamente independiente de la capacidad de identificar individuos.

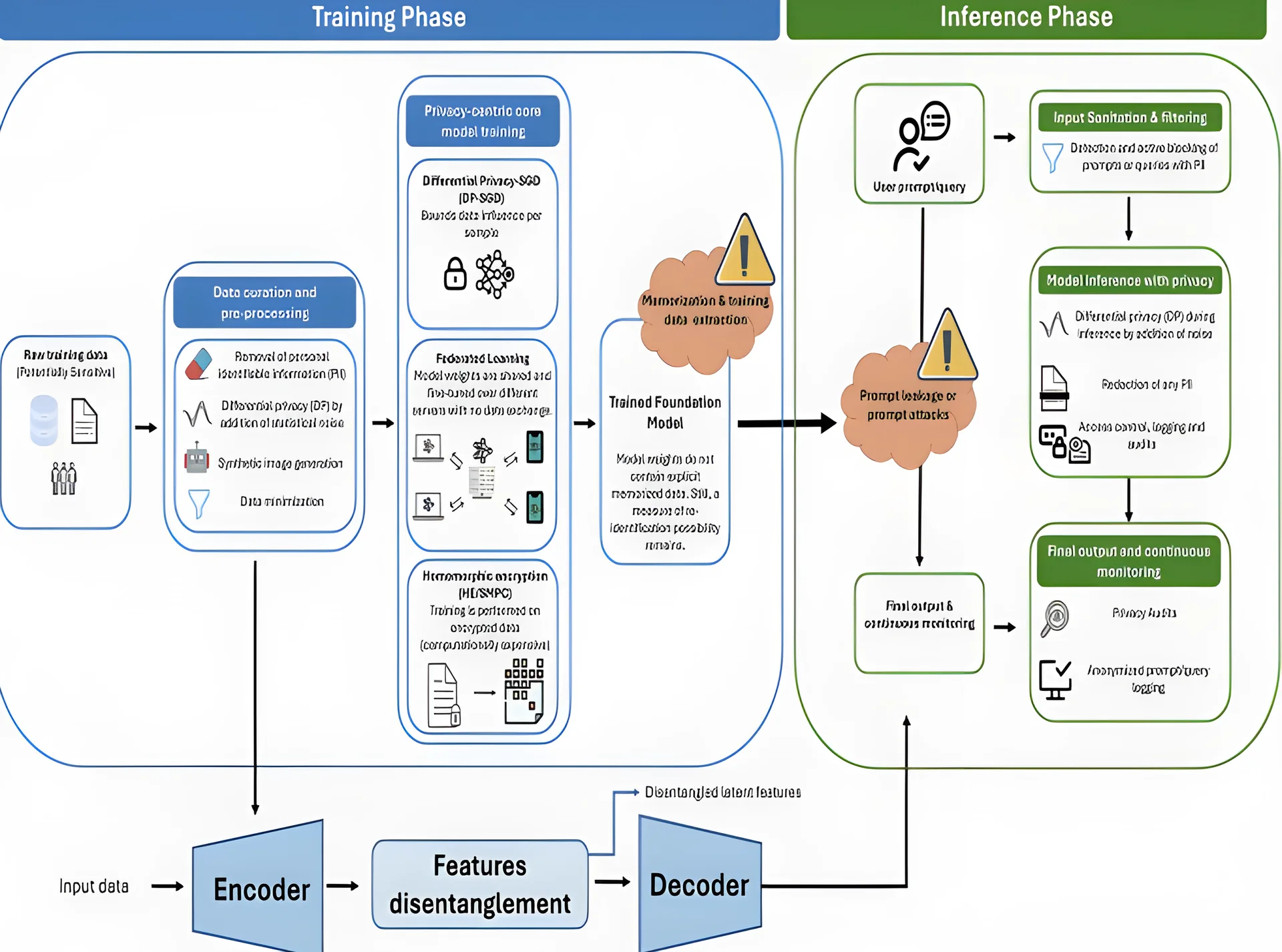

Se proponen soluciones técnicas como la desentrelazamiento de características para separar patrones clínicamente relevantes de detalles identificables. Este método permite que los modelos se centren en marcadores de enfermedad mientras minimizan la exposición de información sensible. Además, se están explorando marcos de aprendizaje federado para reducir el riesgo de filtraciones de datos centralizados manteniendo los datos de entrenamiento descentralizados entre instituciones. La generación de datos sintéticos, combinada con garantías fuertes de privacidad, puede proteger aún más las identidades individuales sin sacrificar la utilidad de los modelos.

A pesar de estos avances, el estudio advierte que las violaciones de privacidad son más probables cuando las salidas del modelo se combinan con fuentes de datos externas. Esto subraya la necesidad de simulaciones empíricas y cohortes de entrenamiento más diversas para evaluar y mitigar con precisión los riesgos reales. Los investigadores argumentan que sin un diseño riguroso y transparencia, los beneficios de los FMs podrían verse socavados por preocupaciones sobre la privacidad.

Marco regulatorio y políticas

Desde una perspectiva política, el estudio destaca la necesidad de actualizaciones legislativas para abordar riesgos específicos de la inteligencia artificial. La Ley de Portabilidad y Protección de la Información Médica (HIPAA) en Estados Unidos podría requerir revisiones para tener en cuenta los desafíos únicos planteados por los modelos fundamentales. De manera similar, el Reglamento General de Protección de Datos (GDPR) de la Unión Europea ofrece un marco sólido para la protección de datos, requiriendo un procesamiento de datos legal, justo y transparente. Bajo el GDPR, los individuos tienen derecho a acceder, corregir, borrar o transferir sus datos personales, y los responsables de los datos deben demostrar el cumplimiento mediante medidas técnicas y organizativas.

El recientemente aprobado Acto de la Unión Europea sobre la Inteligencia Artificial (AI Act) añade otro nivel de regulación, enfatizando la importancia de la privacidad de los datos para los sistemas de inteligencia artificial relacionados con la salud. El Acto introduce evaluaciones basadas en riesgos de algoritmos de inteligencia artificial, con obligaciones específicas para sistemas de alto riesgo, como garantizar que sean imparciales y no discriminatorios. Exige que los proveedores de modelos de inteligencia artificial de uso general divulguen resúmenes de datos de entrenamiento, documentación técnica y estrategias de mitigación de riesgos. El Acto también prohíbe ciertos usos de la inteligencia artificial, como la identificación biométrica en tiempo real en espacios públicos, salvo que estén autorizados estrictamente.

Complementando el AI Act, el Acto de Resiliencia Cibernética de la Unión Europea (CRA), anunciado a finales de 2024, impone requisitos estrictos de ciberseguridad en productos digitales, incluyendo herramientas de salud. El CRA exige que los fabricantes mantengan una lista de componentes de software, aborden vulnerabilidades de productos y reporten incidentes dentro de 24 horas. Los productos se categorizan según su criticidad, con evaluaciones de conformidad más estrictas para sistemas más importantes.

Colaboración interdisciplinaria y aplicaciones en el mundo real

El estudio subraya la importancia de la colaboración interdisciplinaria entre reguladores, investigadores y clínicos para establecer buenas prácticas en la atención médica impulsada por la inteligencia artificial. Garantizar tanto la privacidad como la equidad en los FMs requiere no solo innovación técnica, sino también coordinación intencional entre clínicos, científicos de datos, éticos y expertos en derecho.

La colaboración efectiva debe estructurarse alrededor de tres pilares fundamentales: protocolos de co-diseño que involucren a expertos del sector durante el desarrollo del modelo, marcos de gobernanza compartida como acuerdos de uso conjunto de datos y consejos de revisión ética, y bucles de retroalimentación continua entre usuarios del modelo y desarrolladores. Estas estructuras buscan evaluar iterativamente los impactos en la equidad y garantizar que las estrategias de mitigación se reporten de manera transparente.

Un ejemplo de estos principios en la práctica es una consorcio multiinstitucional de oftalmología que desarrolló un modelo fundamental que preserva la privacidad para predecir la progresión de una rara enfermedad neurodegenerativa de la retina. El modelo utilizó aprendizaje federado para entrenarse en múltiples sitios sin centralizar los datos de los pacientes. Los datos pasaron por un proceso de limpieza de información personal (PII), transformación con privacidad diferencial y minimización para retener solo características clínicas esenciales. Un módulo de desentrelazamiento de características separó aún más las señales relevantes para la enfermedad de atributos sensibles, mejorando la generalización y reduciendo los riesgos de privacidad.

Durante la inferencia, el modelo utilizó sanitización de entrada para bloquear información identificable, y técnicas de privacidad diferencial limitaron la influencia de datos individuales. Esta aplicación en el mundo real demuestra cómo las estrategias técnicas y de gobernanza pueden operacionalizarse para proteger la privacidad de los pacientes mientras se avanza en la inteligencia artificial médica.

A medida que el paisaje regulatorio continúa evolucionando, el estudio enfatiza la necesidad de una estrategia integral para mitigar los riesgos de reidentificación. Las salvaguardas técnicas, como el desentrelazamiento de características, deben priorizarse para aislar patrones clínicamente relevantes y

Comentarios

Aún no hay comentarios

Sé el primero en compartir tu opinión