El presidente Donald Trump ha ordenado a todas las agencias federales de Estados Unidos que dejen de usar inmediatamente el modelo de inteligencia artificial Claude de Anthropic, y ha etiquetado a la empresa como un ‘riesgo para la cadena de suministro’, una designación normalmente reservada para empresas de naciones adversarias. Esta decisión sigue a la negativa de Anthropic de cumplir con la solicitud del Pentágono de eliminar las medidas de seguridad en el uso militar del modelo de inteligencia artificial, citando preocupaciones éticas sobre su posible uso en vigilancia masiva y armas autónomas.

Impacto en contratos del Pentágono y operaciones militares

El Pentágono está dispuesto a terminar su contrato con Anthropic, que tenía un valor de hasta 200 millones de dólares, y exigirá a otros contratistas del gobierno que certifiquen que no usan Claude en sus procesos. Anthropic también será prohibida de participar en cualquier otro trabajo gubernamental, con un período de transición de seis meses para permitir la migración a otros modelos de inteligencia artificial.

Esta decisión es particularmente notable porque Claude es el único modelo de inteligencia artificial actualmente utilizado en los sistemas clasificados del ejército. Se informó que se utilizó en la operación para capturar al presidente venezolano Nicolás Maduro y podría usarse en futuras operaciones militares, como las en Irán.

Oficiales de defensa han reconocido la dificultad de reemplazar a Claude, con uno describiendo el proceso de desvincularse del modelo como un ‘gran dolor de culo’. El movimiento también complica las operaciones para la empresa de software de inteligencia artificial Palantir, que depende de Claude para su trabajo más sensible con el ejército y probablemente necesitará buscar una alternativa.

Tensiones políticas y éticas

La directiva de Trump. Publicada en Truth Social. Acusó a Anthropic de intentar ‘coaccionar’ al Departamento de Defensa y alinear sus políticas con valores ‘woke’ en lugar de la Constitución de Estados Unidos. Llamó la postura de la empresa un ‘error desastroso’ y juró que Estados Unidos ‘nunca permitirá que una empresa radical de izquierda con valores woke determine cómo nuestro gran ejército lucha y gana guerras.’

El director ejecutivo de Anthropic. Dario Amodei. Rechazó previamente la ‘oferta final y mejor’ del Pentágono, afirmando que la empresa no podría cumplir con la solicitud con conciencia. En respuesta. El oficial senior del Pentágono Emil Michael acusó a Amodei de tener un ‘complejo de Dios’ y de poner en riesgo la seguridad nacional.

Amodei afirmó que si el Pentágono decide desvincularse de Anthropic, la empresa trabajará para garantizar una transición suave a otro proveedor, minimizando el impacto en las operaciones militares. Sin embargo. Las apuestas económicas son altas. Ya que Anthropic podría perder cientos de millones en contratos gubernamentales y correr el riesgo de perder clientes que podrían evitar su inteligencia artificial debido a la prohibición.

Implicaciones más amplias para la regulación de la inteligencia artificial

El Pentágono argumenta que el uso de la inteligencia artificial en aplicaciones militares plantea preguntas éticas y legales complejas, y que es impráctico litigar cada caso con empresas privadas. Ha exigido que todas las empresas de inteligencia artificial hagan disponibles sus modelos para ‘todos los propósitos legales’, una postura que ha sido criticada por Anthropic y otros en la industria.

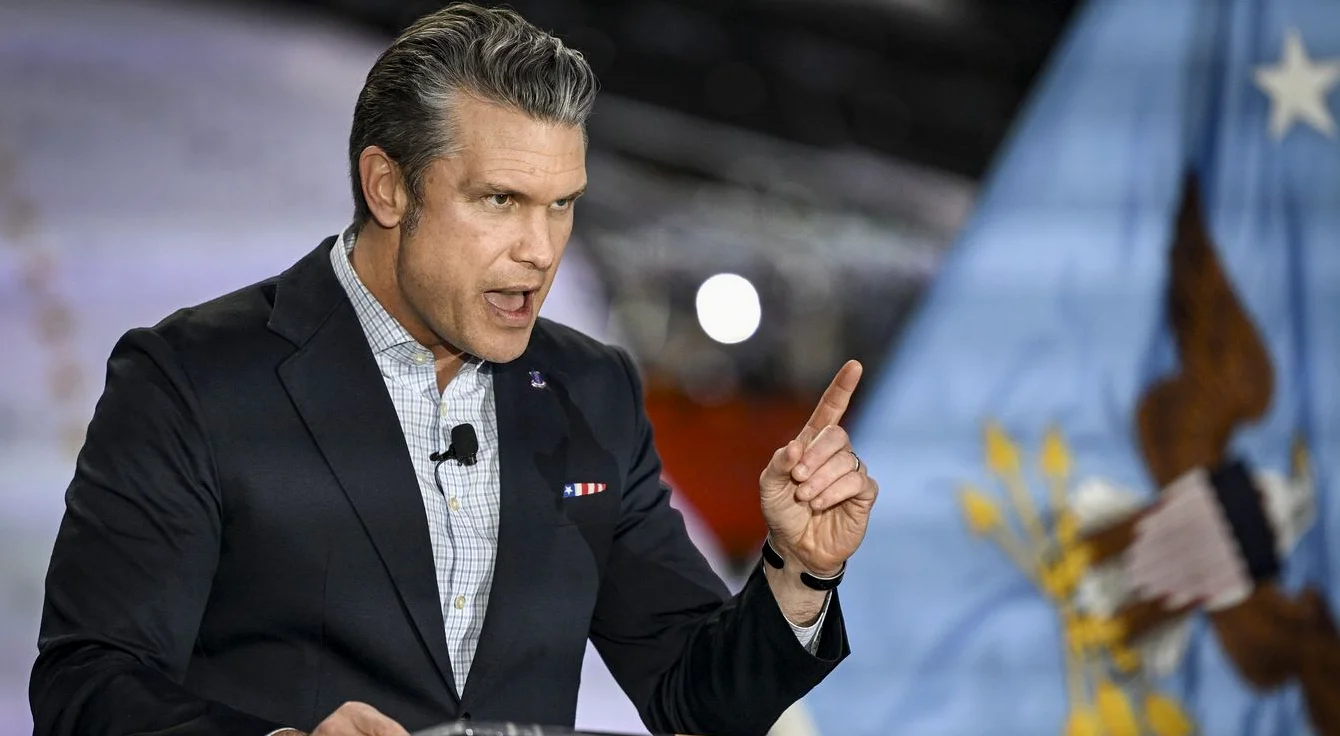

El secretario de Defensa Pete Hegseth ha criticado repetidamente la ‘inteligencia artificial woke’, y la administración de Trump ha ido en aumento en su hostilidad hacia Anthropic, a pesar de la dependencia del ejército de su tecnología. Un oficial de defensa le dijo a Axios que Estados Unidos aún mantiene contactos con Anthropic por necesidad, reconociendo las capacidades de la empresa.

Mientras tanto, el modelo Gemini de Google y el ChatGPT de OpenAI están disponibles en sistemas no clasificados, y el Pentágono está acelerando conversaciones para integrarlos en entornos clasificados. El modelo de inteligencia artificial Grok de Elon Musk’s xAI ha firmado recientemente un acuerdo que permite al ejército usarlo en sistemas clasificados — Sin embargo, fuentes sugieren que Grok no servirá como un reemplazo directo de Claude.

En respuesta a la situación, cientos de empleados de Google y OpenAI han firmado un petición instando a sus empresas a alinearse con la postura de Anthropic sobre el uso ético de la inteligencia artificial. El director ejecutivo de OpenAI, Sam Altman, confirmó que la empresa mantendrá líneas rojas similares sobre la vigilancia y las armas autónomas, pero permanece abierta a negociar con el Pentágono.

Anthropic aún no ha indicado si desafiará la designación del gobierno en los tribunales. La empresa, que ha experimentado un crecimiento rápido y está ganando terreno en aplicaciones empresariales clave, ahora enfrenta un posible reto sobre su posición ética y su futuro financiero.

Comentarios

Aún no hay comentarios

Sé el primero en compartir tu opinión